אנשים בוחרים ביישומי AI לפי "החמימות", לא לפי הביצועים

29 יוני, 2021

מחקר חדש שבוצע בטכניון מגלה שאנשים מגבשים את דעתם על יישומי בינה מלאכותית, לפי הפרמטרים שבהם הם מגבשים דעה על בני אדם אחרים: החמימות (כוונה) מקבלת עדיפות על-פני היכולת

לעתים רבות הצרכנים נדרשים לבחור בין מערכות ושירותים שונים המבוססים על בינה מלאכותית ודומים מאוד אחד לשני, כמו למשל שירותי מיפוי, מנועי חיפוש, אתרי סרטים ומוסיקה ועוד. כיצד הם בוחרים ביניהן? מחקר חדש שבוצע לאחרונה בטכניון מגלה שבניגוד להנחה המקובלת בתעשייה, שלפיה הבחירה מתבצעת בהתאם לביצועי האלגוריתמים של בינה מלאכותית, בפועל היא נעשית בהתאם לגורם אחר לגמרי, שקיבל את הכינוי "חמימות המערכת", או "כוונותיה": נכונותה לעבוד לפעול לטובת המשתמש.

המחקר בוצע על-ידי שלוש חוקרות מהפקולטה להנדסת תעשייה וניהול בטכניון: הדוקטורנטית זהר גלעד, ד"ר עפרה עמיר וד"ר ליאת לבונטין. הן ערכו שישה ניסויים שבהם השתתפו יותר מ-1,600 איש. בכל ניסוי התבקשו המשתתפים לבחור בין שתי מערכות מבוססות בינה מלאכותית שתוארו על-ידי חמימותן (כוונות המערכת) ויכולותיהן. מדובר בשני מימדים להערכה ושיפוט של אנשים אחרים שנחקרו רבות בפסיכולוגיה חברתית. כיום מוסכם בתחום שהן רלוונטיות גם לשיפוט אנושי כלפי ישויות לא-אנושיות כגון סוכנים וירטואליים ורובוטים. במילים אחרות, אנשים מייחסים כוונות ויכולות גם למערכות מלאכותיות המבוססות על בינה מלאכותית.

לטובת מי המערכת עובדת?

המחקר הנוכחי, בניגוד למרבית המחקרים בנושא, התמקד במערכות בינה מלאכותית שאין להן נוכחות פיזית או וירטואלית (מערכות המלצה דוגמת נטפליקס וספוטיפיי). החוקרות את החמימות של המערכת על סמך המרוויח העיקרי מהשימוש בה – את מי המערכת מציבה בראש סדר העדיפויות. כך למשל כאשר המשתמש מפעיל אפליקציית ניווט מסויימת, הוא יכול לחוש שהדרך שהיא מציעה אינה הדרך המהירה ביותר ושהאפליקציה מנסה לבדוק על חשבונו אם יש פקק בדרך או ללמוד על מהירות הנסיעה בדרכים צדדיות. תחושה כזו מעידה על תפיסת חמימות נמוכה של המערכת – המשתמש אינו משוכנע שהיא פועלת לטובתו.

החוקרות מצאו שהחמימות שמייחסים למערכת היא שיקול חשוב בעיני משתמשים פוטנציאליים, והשפעתה גדולה מהשפעת היכולת הביצועית של המערכת. מרבית האנשים העדיפו מערכת חמימה על פני מערכת בעלת יכולות טכנולוגיות גבוהות. העדפה זו נמשכה אפילו כאשר המערכת החמימה הייתה בעלת נחיתות טכנולוגית מוצהרת. כך לדוגמה, כאשר המשתמשים התבקשו לבחור בין שתי מערכות שממליצות על ביטוח רכב, מרביתם העדיפו מערכת עם יכולת נמוכה (המבוססת על אלגוריתם בסיסי שאומן על 1,000 החלטות קודמות) וחמימות גבוהה (פותחה עבור אנשים כמוהם), על-פני מערכת עם יכולת גבוהה (מבוססת אלגוריתם חדשני שאומן על 1,000,000 החלטות קודמות) וחמימות נמוכה (פותחה עבור סוכני ביטוח).

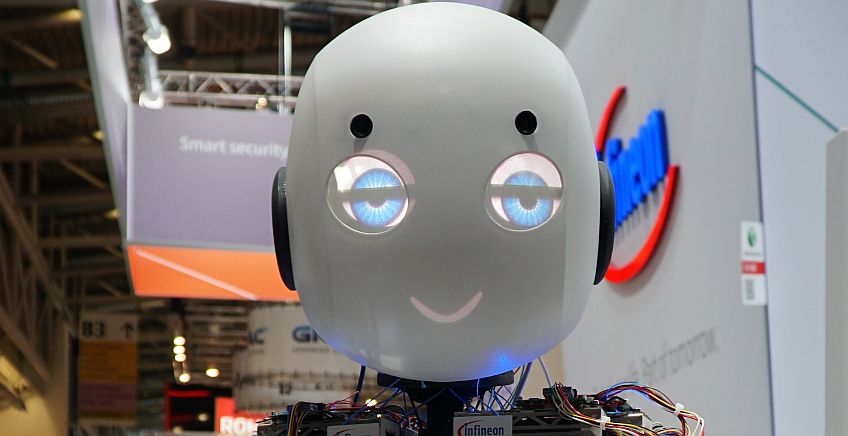

רובוטים כבני-אדם…

באופן דומה, מרביתם העדיפו מערכת המלצת סרטים בעלת אלגוריתם נחות שמתבססת רק על מידע שמגיע מהם, על-פני מערכת בעלת אלגוריתם מתקדם שמתבססת על מידע המגיע מהם, אך במקביל גם מנסה לקדם סרטים מסוימים. כלומר, הצרכנים מוכנים לוותר במידה מסוימת על יכולות של המערכת אם הם מאמינים שהיא ידידותית ופועלת לטובתם.

הממצאים האלו דומים מאוד לממצאים המתקבלים במחקר על אינטראקציות בין בני אדם, שכן גם בשיפוט של בני אדם אחרים תפיסת החמימות (הכוונה) מקבלת עדיפות על תפיסת היכולת. מהמחקר הנוכחי אפשר ללמוד כי אנשים משתמשים באותם חוקים חברתיים כדי לשפוט בני אדם ומערכות מבוססות בינה מלאכותית. המחקר מומן בהשתתפות הקרן הלאומית למדע (ISF) והוצג לאחרונה בכנס CHI Conference on Human Factors in Computing.

פורסם בקטגוריות: בינה מלאכותית , חדשות , טכנולוגיות מידע , רובוטיקה

פורסם בתגיות: AI , בינה מלאכותית